După o epocă de aur a internetului și a noilor tehnologii, în care ne-am aruncat frenetic în tot ce are de oferit ecosistemul digital, a venit vremea să facem un pas înapoi și să analizăm la rece efectele transformărilor radicale generate de tehnologie. Lumea lui 2017 e, în foarte mare parte, influențată invizibil de algoritmi care procesează ceea ce numim big data (cantități uriașe de informație, ce pot fi analizate matematic pentru a observa pattern-uri și tendințe, inclusiv în ceea ce privește comportamentul și interacțiunile umane). Fie că este vorba de vorba de sisteme de evaluare a universităților și profesorilor, de baze de date în funcție de care se decide dacă primești sau nu credit, de felul în care ni se livrează publicitatea personalizată sau ne sunt influențate opțiunile politice în spațiul virtual, ori de noul sistem prin care China calculează creditele sociale pentru fiecare cetățean, toate acestea au în spate modele matematice.

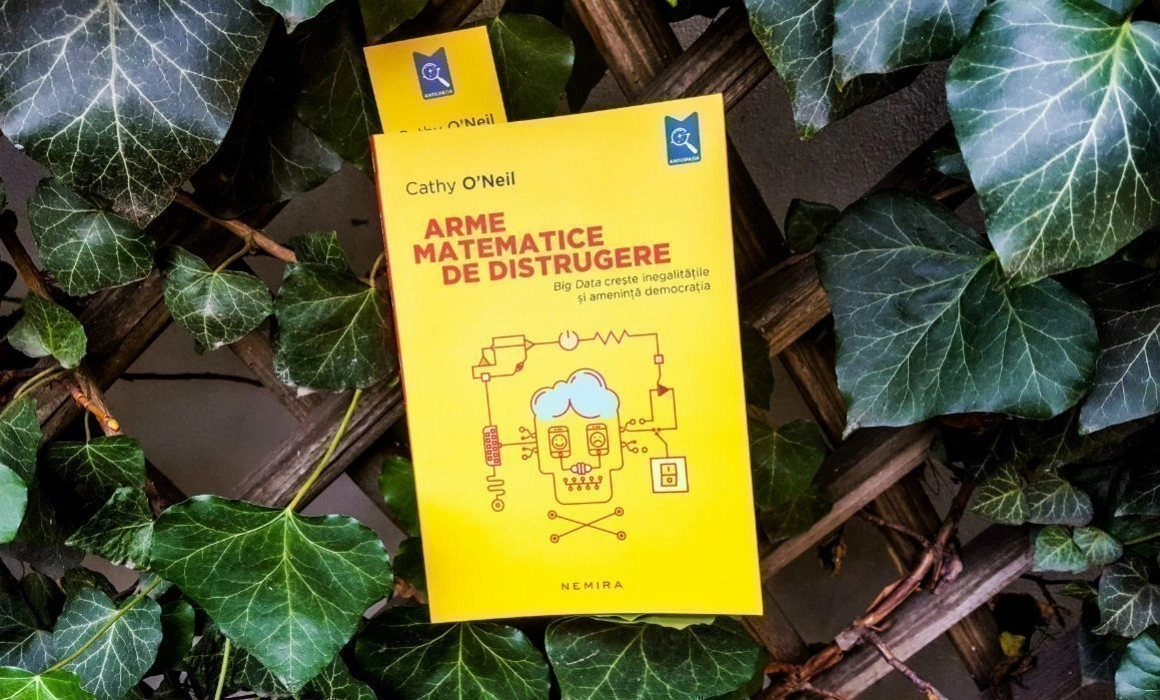

Doar că, după cum spune Cathy O'Neil, informaticiană și jurnalistă, acești algoritmi sunt „câtuși de puțin transparenți, nereglementați și imposibil de combătut”, ceea ce-i transformă în arme matematice de distrugere. O'Neil, care a scris multă vreme pentru „Wall Street Journal”, și-a dat demisia de la ziar pentru a cerceta cum algoritmii în care specialiștii își puseseră speranța că vor aduce evaluare echitabilă și nepărtinitoare, amplifică, de fapt, inegalitățile sociale. Mai mult, spune O'Neil, amenință „să sfâșie țesutul social”. (Deloc întâmplător, zilele trecute, un fost director în compania Facebook folosea aceeași expresie pentru a descrie efectul rețelelor sociale.) În cartea „Arme matematice de distrugere. Big Data crește inegalitățile și amenință democrația”, nominalizată la National Book Award și proaspăt tradusă la Editura Nemira, jurnalista americană adună în 10 capitole nenumărate exemple despre ce se întâmplă când unele decizii vitale pentru viețile oamenilor sunt luate de mașini. E foarte important să citiți cartea asta, fiindcă scoate la lumină dedesubturile extrem de încâlcite ale unora dintre practicile noastre de zi cu zi - de la statul pe Facebook, la faptul că ne sunt colectate date legate de starea de sănătate - și fiindcă explică foarte limpede riscurile la care ne expunem, dacă nu cunoaștem și nu putem controla acești algoritmi. Până ajungeți să puneți mâna pe carte, vă propunem să citiți un fragment din capitolul „Cetățeanul-țintă: Viața civică”, foarte potrivit acum, când wall-urile de pe Facebook-ul românesc seamănă din ce în ce mai mult a câmpuri de bătălie.

După cum știți deja, mă revoltă tot felul de AMD-uri [arme matematice de distrugere, n.r.]. Deci să ne imaginăm că decid să lansez o campanie pentru reglementări mai dure și public o petiție pe pagina mea de Facebook. Care dintre prietenii mei o vor vedea în fluxul de știri?

Habar nu am. De îndată ce o lansez, ea aparține Facebook-ului, iar algoritmul rețelei de socializare judecă cum să o folosească cel mai bine. Calculează șansele pe care le are de a-i atrage pe fiecare dintre prietenii mei. El știe deja că unii dintre ei semnează adesea petiții și, probabil, le distribuie în propriile lor rețele. Alții au tendința să le ignore. În același timp, o parte dintre prieteni îmi acordă mai multă atenție și tind să dea clic pe articolele pe care le public. Algoritmul Facebook ia în considerare toate acestea când decide cine va vedea petiția mea. Pentru mulți dintre prietenii mei, ea va fi îngropată atât de adânc în fluxul de știri, încât nu o vor vedea niciodată.

Asta se întâmplă atunci când rețeaua extrem de puternică pe care o împărțim cu 1,5 miliarde de utilizatori este și o corporație cotată la bursă. În vreme ce Facebook părea noul loc de întâlnire din oraș, compania decidea, în funcție de propriile interese, ce anume să vedem și să aflăm în rețeaua sa de socializare. La ora la care scriu aceste lucruri, aproximativ două treimi dintre adulții americani au un profil pe Facebook. Ei petrec 39 de minute pe rețea, în fiecare zi, cu doar patru minute mai puțin decât îi dedică socializării „față în față“. Aproape jumătate dintre ei, potrivit unui raport al Centrului de Cercetare Pew, contează pe Facebook ca să le livreze cel puțin o parte din știri, ceea ce duce la întrebarea: Prin adaptarea algoritmului și trierea știrilor pe care le vedem, se poate juca Facebook cu sistemul politic?

Cercetătorii din companie au făcut o analiză. În timpul alegerilor din 2010 și 2012, Facebook a făcut experimente pentru a-și perfecționa un instrument pe care l-a numit „megafonul alegătorului“. Ideea era să încurajeze oamenii să declare că au votat. Părea destul de rezonabil. Plasând în fluxurile de știri ale oamenilor actualizările „Am votat“, Facebook îi încuraja pe americani – peste șaizeci și unu de milioane – să-și îndeplinească datoria civică și să-și facă auzită vocea. Mai mult, prin articolele publicate despre comportamentul la vot al oamenilor, site-ul crea o presiune a anturajului pentru participarea la vot. Studiile au arătat că satisfacția personală a îndeplinirii unei îndatoriri civice este mai puțin probabil să pună oamenii în mișcare decât posibila judecată a prietenilor și a vecinilor.

În același timp, cercetătorii Facebook studiau modul în care diferitele tipuri de actualizări influențau comportamentul oamenilor în perioada votului. Niciun cercetător nu a lucrat vreodată într-un laborator uman de această anvergură. În câteva ore, Facebook putea recolta informații de la zeci de milioane de oameni sau mai mult, măsurând impactul pe care îl aveau cuvintele și link-urile distribuite asupra fiecăruia dintre ei. Și ar putea folosi aceste cunoștințe pentru a influența acțiunile oamenilor, care în acest caz, se întâmpla să voteze.

Iată o cantitate de putere considerabilă. Iar Facebook nu este singura companie care o mânuiește. Alte corporații listate la bursă, incluzând Google, Apple, Microsoft, Amazon și companii de telefonie mobilă precum Verizon și AT & T, dețin informații uriașe despre o mare parte a populației umane, precum și mijloacele de a ne conduce după bunul lor plac.

De obicei, așa cum am văzut, ele sunt preocupate să facă bani. Totuși, profiturile lor sunt strâns legate de politicile guvernamentale. Guvernul le reglementează sau nu, le aprobă sau le blochează fuziunile și achizițiile și le stabilește politicile fiscale (adesea închizând ochii la miliardele parcate în paradisurile fiscale off-shore). Acesta este motivul pentru care companii de tehnologie, ca și restul Americii corporatiste, inundă Washingtonul cu lobby-iști și, pe șest, toarnă sute de milioane de dolari în contribuții pentru sistemul politic. Acum își câștigă mijloacele necesare pentru a ne ajusta comportamentul politic, și odată cu el, și structura guvernului american, doar prin modificarea algoritmilor.

Campania Facebook a început cu un scop constructiv și aparent nevinovat: să-i încurajeze pe oameni să voteze. Și au reușit. După ce au comparat înregistrările voturilor, cercetătorii au estimat că respectiva campanie a sporit participarea la vot cu 340 000 de persoane. Este un număr suficient ca să schimbe situația în state întregi, și chiar la nivel național. Să nu uităm că George W. Bush a câștigat în 2000 cu o marjă de 537 de voturi în Florida. Este clar că activitatea unui singur algoritm Facebook în ziua alegerilor nu numai că ar putea schimba echilibrul în Congres, dar poate decide și președinția.

Puterea Facebook nu vine numai din amploarea sa, ci și din abilitatea de a-și folosi propriii clienți pentru a-i influența pe prietenii lor. Majoritatea celor șaizeci și unu de milioane de persoane din experiment au primit un mesaj pe pagina lor de știri, încurajându-i să voteze. Mesajul includea și câteva fotografii: șase dintre prietenii de pe Facebook ai utilizatorului, aleși la întâmplare, care apăsau pe butonul „Am votat“. Cercetătorii au studiat, totodată, două grupuri de control, fiecare numărând aproximativ șase sute de mii de profile. Un grup a văzut campania „Am votat“, dar fără fotografiile prietenilor. Celălalt grup nu a primit nimic.

Prin împrăștierea mesajelor în rețea, Facebook studiază impactul comportamentului prietenilor asupra noastră. Oare oamenii și-ar încuraja prietenii să voteze și acest lucru ar afecta comportamentul acestora? Potrivit calculelor cercetătorilor, faptul că prietenii au participat la vot, a contat foarte mult. Oamenii acordau mult mai multă atenție atunci când actualizările „Am votat“ veneau de la prieteni și erau mult mai predispuși să împărtășească aceste actualizări. Aproximativ 20 de procente dintre cei care au văzut că prietenii lor au votat, au dat și ei clic pe butonul „Am votat“. Dintre cei care nu au primit butonul de la prieteni, doar 18% au votat. Nu putem fi siguri că toți oamenii care au dat clic pe buton au și votat efectiv sau că cei care nu au dat clic au rămas acasă. Cu toate acestea, cu șaizeci și unu de milioane de alegători în rețea, o posibilă diferență de două puncte poate fi imensă.

Doi ani mai târziu, Facebook a mers mai departe. Timp de trei luni înainte de confruntarea electorală dintre președintele Obama și Mitt Romney, un cercetător al companiei, Solomon Messing, a modificat algoritmul de alimentare a fluxului de știri pentru aproximativ două milioane de oameni, toți implicate politic. Aceștia au primit o cantitate mai mare de știri importante, total diferite de obișnuitele videoclipuri cu pisici, anunțuri de absolvire sau fotografii de la Disney World. Dacă prietenii lor distribuiau o poveste din flux, ea apărea în partea de sus a paginii lor de știri.

Messing a vrut să vadă dacă obținerea mai multor știri de la prieteni schimbă comportamentul politic al oamenilor. După alegeri, a trimis sondaje. Rezultatele raportate în mod automat au arătat că participarea votanților din acest grup a crescut de la 64 la 67%.

„Când prietenii îți distribuie ziarul“, spunea Lada Adamic, sociolog informatician la Facebook, „se întâmplă lucruri interesante“. Bineînțeles, cei care distribuiau ziarul nu erau tocmai prietenii, ci chiar Facebook. S-ar putea argumenta că, de o veșnicie, ziarele exercită o putere similară. Editorii selectează știrile de primă pagină și decid ce tendință să dea acestora. Ei sunt cei care aleg dacă prezintă palestinieni bombardați sau israelieni în doliu, ori un polițist salvând un copil sau bătând un protestatar. Aceste decizii pot influența, fără îndoială, atât opinia publică, cât și alegerile. Este valabil și pentru știrile de televiziune. Dar când New York Times sau CNN prezintă o poveste, toată lumea o vede. Decizia editorială este clară, oficială. Nu este opacă. Și oamenii dezbat mai târziu (adesea pe Facebook) dacă decizia a fost cea corectă.

Facebook seamănă mai mult cu Vrăjitorul din Oz: nu vedem ființele umane implicate. Când vizităm site-ul, defilăm prin actualizări de la prietenii noștri. Mașina pare să fie doar un intermediar neutru. Mulți oameni încă mai cred că este. În 2013, când Karrie Karahalios, cercetător de la Universitatea din Illinois, a realizat un sondaj asupra algoritmului Facebook, a constatat că 62% din oameni nu erau conștienți că firma se joacă cu fluxul de știri. Ei credeau că sistemul distribuie instantaneu tot ce publică ei, tuturor prietenilor lor.

Potențialul Facebook de a-și exercita influența asupra politicii noastre se extinde dincolo de plasarea știrilor și campaniile „Mergeți la vot“. În 2012, niște cercetători au desfășurat un experiment pe 680 000 de utilizatori Facebook pentru a vedea dacă actualizările din fluxurile lor de știri le-ar putea afecta starea de spirit. Din experimentele de laborator, era deja clar că starea de spirit este contagioasă. A fi în preajma unui morocănos te poate face să devii și tu la fel, chiar dacă doar pentru scurt timp. Dar ar fi posibil ca astfel de contagiuni să se răspândească online?

Folosind software-ul lingvistic, Facebook a selectat actualizări pozitive (încântătoare!) și negative (dezamăgitoare!). Apoi au redus volumul articolelor întristătoare în jumătate din fluxul de știri, reducând simultan coeficientul de veselie în cealaltă jumătate. Când au studiat comportamentul ulterior al utilizatorilor, au găsit dovezi că noile știri „aranjate“ chiar le-au modificat starea de spirit. Cei care au văzut mai puține actualizări vesele au avut mai multe publicări negative. Un model similar a apărut și pentru partea pozitivă.

Concluzia lor: „Stările emoționale pot fi transferate altora…, ceea ce îi determină pe oameni să trăiască aceleași emoții fără să-și dea seama“. Cu alte cuvinte, algoritmii Facebook pot afecta modul în care se simt milioane de oameni, fără ca acei oameni să știe ce se întâmplă. Ce s-ar întâmpla, dacă s-ar juca cu emoțiile oamenilor în ziua alegerilor?

Nu am niciun motiv să cred că specialiștii în științe sociale de la Facebook se joacă efectiv cu sistemul politic. Cei mai mulți sunt profesori universitari serioși, care efectuează cercetări pe o platformă la care puteau doar să viseze cu două decenii în urmă. Dar ceea ce au demonstrat este puterea enormă a Facebook de a afecta ceea ce aflăm, modul în care simțim și eventualitatea participării la vot. Platforma sa este masivă, puternică și opacă. Algoritmii rămân ascunși, iar noi vedem doar rezultatele experimentelor pe care cercetătorii decid să le publice.

Aproape același lucru este valabil și pentru Google. Algoritmul său de căutare pare să se concentreze pe creșterea veniturilor. Dar, rezultatele căutării, dacă Google hotărăște astfel, ar putea avea un efect dramatic asupra a ceea ce oamenii află și modului în care votează. Doi cercetători, Robert Epstein și Ronald E. Robertson, le-au cerut recent alegătorilor nehotărâți, atât din Statele Unite, cât și din India, să folosească un motor de căutare pentru a afla mai multe despre viitoarele alegeri. Motoarele pe care le foloseau erau programate să modifice rezultatele căutării, favorizând un partid față de altul. Cercetătorii au afirmat că aceste rezultate au schimbat preferințele de vot cu 20%.

Acest efect a fost puternic, în parte, pentru că oamenii au mare încredere în motoarele de căutare. Aproximativ 73% dintre americani, conform unui raport al Pew Research, consideră că rezultatele căutării sunt atât corecte, cât și imparțiale. Prin urmare, companii precum Google și-ar risca reputația și ar genera o înăsprire a reglementărilor dacă s-ar dovedi că au manevrat rezultatele pentru a favoriza un rezultat politic în detrimentul altuia. Și, din nou, cum ar putea să afle cineva? Ce știm despre acești giganți ai Internetului provine mai ales din mica parte a cercetărilor pe care ei le fac publice. Algoritmii lor reprezintă secrete comerciale importante. Ei își desfășoară afacerea în întuneric. [...]

„Arme matematice de distrugere. Big Data crește inegalitățile și amenință democrația”, de Cathy O'Neil, traducere de Radu Cimponeriu, a apărut în 2017 la Editura Nemira, în colecția „Anticipația”.